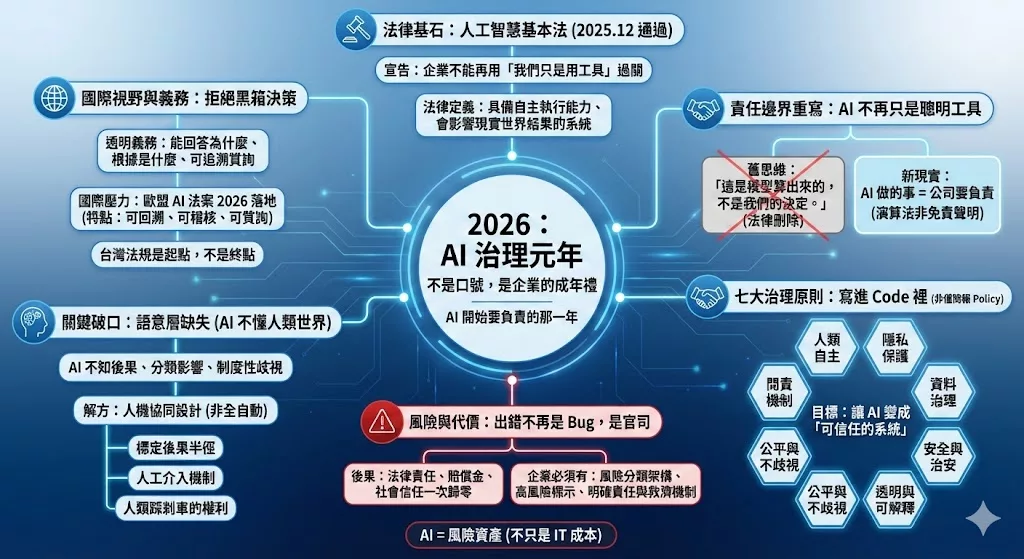

先說結論:2026 年不是 AI 爆發年,是 AI 開始要負責的那一年。

台灣在 2025 年 12 月23日立法院三讀通過《人工智慧基本法》,正式宣告一件事:企業不能再用「我們只是用工具」這一招來過關了。

從這一刻開始,AI 不只是技術選項,而是公司治理的一部分。

富方創投執行合夥人宋俊明在2026年1月5日《永續e起來》直播公益講堂中分享其觀察與觀點,特整理內容摘要:

一、責任邊界重寫中:AI 不再只是「很聰明的工具」

以前企業常說一句話:「這是模型算出來的,不是我們的決定。」

2026 年開始,這句話法律直接幫你刪掉。因為 AI 基本法已經把 AI 定義為:

👉 「具備自主執行能力、會影響現實世界結果的系統」

翻成白話就是:

- AI 做的事 = 公司要負責

- 模型不是替罪羊

- 演算法不是免責聲明

只要系統有「判斷」,像是拒絕貸款、排序曝光、調整收益、篩選對象,責任永遠回到公司身上。

二、七大治理原則不是寫在簡報,是寫進系統

很多企業以為治理是寫 Policy。法律的意思其實是:你要寫進 Code 裡。

宋俊明老師提出,AI 基本法確立的七大原則,企業不能只背名字,要能落地:

- 人類自主

- 隱私保護

- 資料治理

- 安全與治安

- 透明與可解釋

- 公平與不歧視

- 問責機制

這七條的共同目標只有一個:

👉 讓 AI 變成「可信任的系統」,而不是跑得很快的黑箱。

三、AI 出錯,代價不再是 Bug,而是官司

接下來是很多人忽略、但法務會很在意的地方。

未來企業必須要有:

- 風險分類架構

- 高風險應用標示

- 明確的責任歸屬與救濟機制

因為一旦 AI 出錯,

付出的不只是「系統暫停」,而是:

- 法律責任

- 賠償金

- 社會信任一次歸零

簡單說:AI 不只是 IT 成本,是風險資產。

四、真正的破口:不是算力,是「語意層」缺失

很多災難型 AI 案例,不是因為數學算錯,而是 AI 不懂人類世界在幹嘛。宋俊明老師大膽假設,認為這應是AI的 Semantic Layer(語意層)缺失。

AI 很會算,但它不知道:

- 這個決定對人意味著什麼

- 這個分類會不會毀掉一個家庭

- 這個分數是不是在制度性歧視

所以企業在設計 AI 時,必須做到三件事:

- 標定後果半徑(這個決定會影響誰、多遠、多深)

- 人機協同設計(不是全自動)

- 人工介入、暫停、回滾機制一定要有

一句話:再聰明的 AI,也要有人類踩剎車的權利。

五、透明與可解釋,不是選項,是義務

當 AI 參與決策,企業必須能回答三個問題:

- 為什麼做這個決定?

- 根據是什麼?

- 能不能被追溯與質詢?

法律明確反對三個字:👉 黑箱決策

尤其是涉及特定族群、弱勢族群、勞動者、移民、罷工者,只要演算法出現偏見,不只是被罵,是可能被要求「停止執行」。

六、國際企業要醒:歐盟會來查帳

如果你的企業有跨國業務,

請記住一句話:台灣法規是起點,不是終點。

歐盟 AI 法案將在 2026 年全面落地,特色只有一個:可回溯、可稽核、可質詢。

你進歐洲市場,不是看模型多強,而是看你的 AI 決策鏈能不能被打開來看。

給企業的一份冷靜清單

- 中央主管機關:國科會

- AI 不再是黑箱,是公司治理的一部分

- 行銷與命名要謹慎,不要自己把系統吹成「高度自主」,然後法律真的照單全收

結論:

AI 轉型不是幫公司裝渦輪,而是幫自動駕駛車裝上剎車、方向盤與責任歸屬。跑得快不重要,跑得久、跑得不翻車,才叫永續。